La reconnaissance faciale cherche le bon profil

En une seconde, un système de reconnaissance faciale est capable d’identifier un visage parmi 36 millions. En théorie...

Le procédé mis au point par Hitachi Kokusai Electric pourrait intéresser de nombreux pays dans leur lutte contre le terrorisme. À partir d’une photo ou d’images prises par une caméra de vidéosurveillance, il serait capable d’identifier en temps réel une personne parmi 36 millions !

Le constructeur n’a pas dévoilé ses secrets. Il a par contre confirmé que son système n’était pas encore optimisé. Pour obtenir une bonne détection il faut que les visages mesurent 40 x 40 pixels et qu’ils se présentent sous un angle maximal de 30° verticalement et horizontalement par rapport à la caméra (seules des images en 3D permettent de contourner cet obstacle). Sans parler bien sûr de l’exposition du visage à la luminosité. Selon son intensité, la détection est plus ou moins pertinente.

Malgré tout, Hitachi Kokusai Electric annonce sa commercialisation d’ici un an. Il vise en priorité les domaines des chemins de fer, des centrales électronucléaires et des grandes surfaces. Utilisée principalement pour l’identification (contrôle aux frontières) et la délivrance de documents d’identité, la biométrie faciale a connu un essor suite aux événements du 11 septembre 2001.

La plus grande expérience a eu lieu en janvier 2001… au Raymond James Stadium de Tampa en Floride. À l’occasion du Super Bowl, la police de la ville a filmé, à leur insu, le visage de plusieurs dizaines de milliers de personnes qui entraient dans le stade. Un système de reconnaissance de la forme du visage a ensuite comparé tous ces portraits aux images contenues dans des bases de données. Objectif : identifier des terroristes et des criminels dans la foule. Mais aucune arrestation n’a été menée.

À ce jour, aucun traitement informatique n’a réussi à égaler le couple œil humain + mémoire. Les premiers travaux ont été réalisés par le professeur Teuvo Kohonen en 1989, chercheur en réseaux neuronaux de l’Université d’Helsinki, et ceux de Kirby et Sirovich (1989) de l’Université Brown du Rhode Island. Celui-ci avait mis au point au Massachusetts Institute of Technology of Boston (MIT) un système de reconnaissance du visage nommé eigenface.

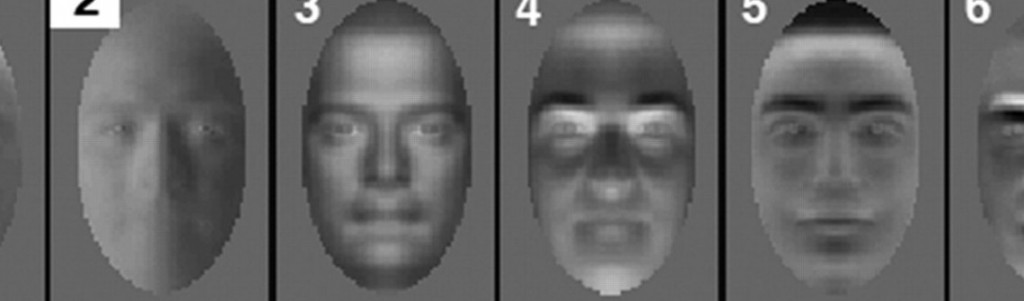

La reconnaissance faciale consiste notamment à extraire des caractéristiques du visage qui sont conservées dans une base de données. Par exemple, le eigenface décompose l’image bidimensionnelle capturée en une série d’images teintées avec des nuances de gris différentes. Quant au feature analysis, son dérivé, il est un peu plus souple puisqu’il permet de mieux prendre en compte les déformations du visage, l’éclairage et les angles horizontaux et verticaux.

Début 2014, des chercheurs de l’université de Hong Kong avaient présenté leur algorithme nommé GaussianFace. Il était capable de gérer différentes composantes parfois mal analysées par certains systèmes : un mauvais éclairage ou des changements physiques (maquillage, coupe de cheveux) ne seraient pas un problème pour ce super-système.

Mais la théorie ne correspond pas à la réalité. Et c’est sur ce point que bute cette solution. Sa performance est liée à plusieurs paramètres essentiels et en particulier la qualité de l’image. Elle dépend en grande partie du contexte dans lequel la biométrie faciale est captée. « Il faut bien distinguer les usages qui relèvent de l’authentification en situation dite “coopérative”, c’est-à-dire lorsque la personne se prête volontairement à la captation de son visage (et suit les consignes qui lui sont données) et ceux pour lesquels la captation s’effectue de façon “non coopérative” à des fins d’identification », avait précisé Claude Bauzou, chef de produit chez Morpho (groupe Safran, leader mondial des technologies de reconnaissance biométrique) au site securiteoff.com.

Par ailleurs, la fiabilité de la reconnaissance faciale dépend de l’étendue et de la qualité des bases de données accessibles.

Source : https://www.techniques-ingenieur.fr